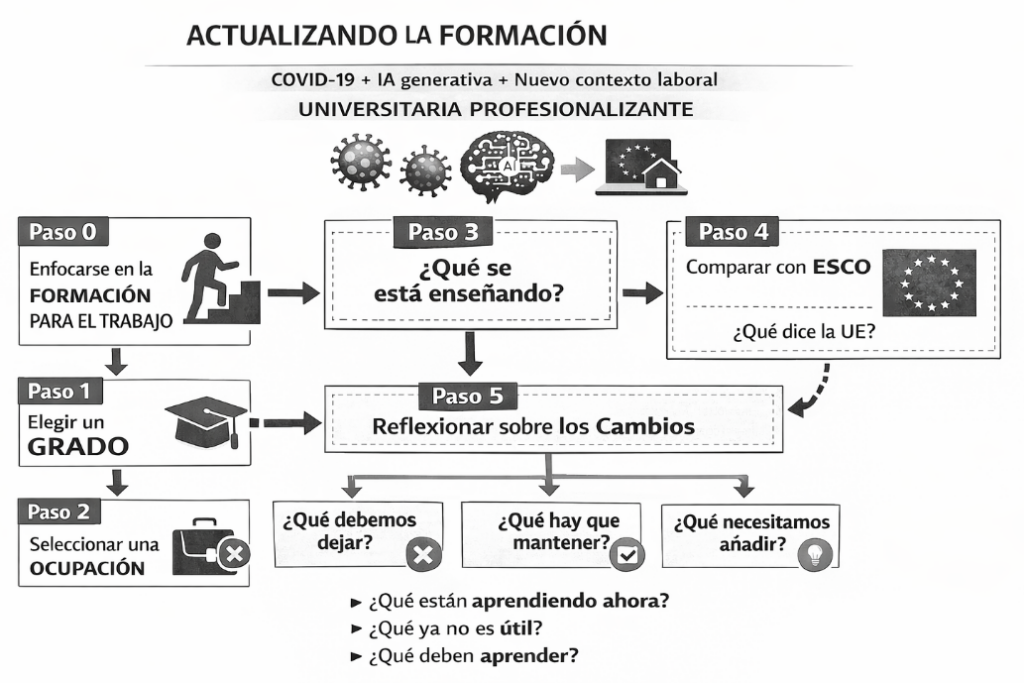

- ¿Qué están aprendiendo ahora?

- ¿Qué deberían dejar de aprender porque no es útil?

- ¿Qué cosas nuevas deberían empezar a aprender porque las necesitarán para ser buenas profesionales?

Caso de uso:

(en construcción)

Visitas: 7

(en construcción)

Visitas: 7

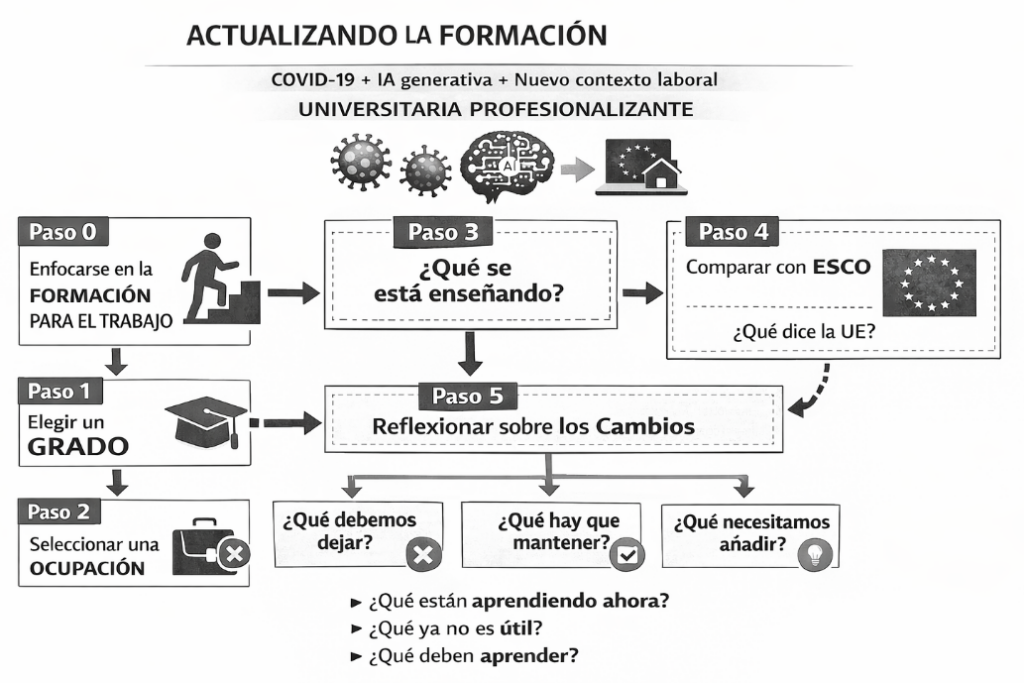

Marco AIR para uso responsable de IA: útil pero revelador de nuestras inconsistencias

Young, J. (2026). AIR: AI in Research – A framework for transparent and responsible AI use mapped to the research process (Version 1). figshare. https://doi.org/10.6084/m9.figshare.31268020.v1

Creo que es muy útil para resolver algunas de las dudas que surgen en mis charlas sobre IA generativa en Research.

Con esta tabla, en menos de 5 minutos, puedes informar con transparencia sobre el uso que has hecho de la IA y las verificaciones que has realizado (la última columna) para estar seguro de que lo etiquetado como riesgo moderado no representa ningún “concern” para la validez de tu trabajo.

Intentar justificar que lo etiquetado como riesgo elevado no te afecta podría dar lugar a un artículo por cada una de las casillas de la columna A4.

Y este es el talón de Aquiles de todo esto… si alguien te obliga a demostrar punto por punto que estás exento de riesgos y sesgos, igual necesitas uno o dos años de trabajo para justificar adecuadamente cualquier artículo… incluso los que has escrito completamente “a mano” sin ayuda de ninguna IA generativa.

Es un poco sorprendente el doble rasero que se aplica, no pidiendo ninguna justificación si lo haces tú solito (proyectando todas tus torpezas y sesgos implícitos), y abrumándote con justificaciones si te apoyas en IA generativa. No, si no está prohibido que la uses, pero si dices que la usas, debes invertir una burrada de horas de trabajo para justificar “adecuadamente” que el uso ha sido correcto.

¿Alguien me ha preguntado alguna vez si he usado correctamente SPSS en los artículos que he escrito en los últimos 30 años? ¡Pero si, las veces que intento adjuntar la sintaxis, los revisores me dicen que quite esa información porque les “despista” y hace innecesariamente largo el artículo!

Visitas: 81

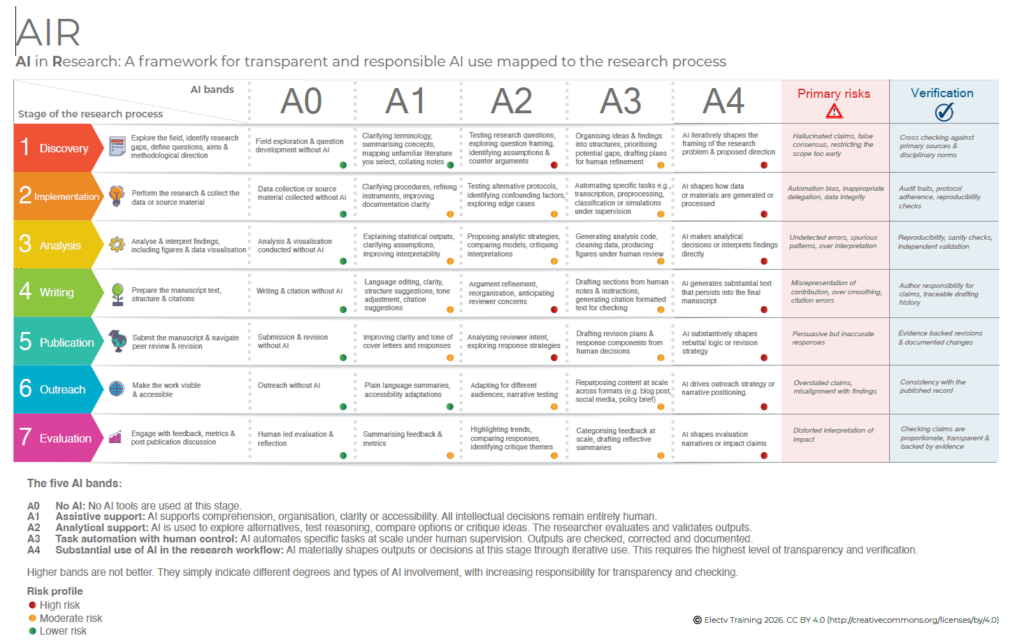

Ya he completado las tareas. Tanto la “obligatoria” de presentar los papeles en ANECA, como la voluntaria de hacer una reflexión personal (Rellenar sexenios de investigación: mi propuesta para transformarlo | Blog de Juan A. Marin-Garcia).

Voy a compartir mi reflexión personal del proceso, si me ha servido para algo y las sensaciones que me han ido provocando las diferentes decisiones que he ido tomando.

Empecemos por algunos hechos:

Y pasemos ahora a mis inferencias, opiniones y percepciones. Para mí, estos son los “takeaways” que me llevo del proceso de reflexión, siendo consciente de que son solo el modo en que veo el asunto y, sin duda, están sesgados.

Algunos de los que yo considero mis mejores trabajos por lo que ha supuesto escribirlos, la contribución que yo creo que tienen en la academia y en la sociedad y que, además, han sido de los más citados (no me creo que las citas indiquen nada, pero supongo que para mucha gente este es un indicador imprescindible), no los puedo poner como meritos porque sería un suicido (directamente me van a poner un cero porque cumplen alguno o varios de los criterios de minoración de puntuaciones). Por ejemplo:

No me apetece jugármela a tener que defender mis méritos en una reclamación, de modo que voy a ser cauto y conservador y elegir como méritos los que creo que van a gustar al panel, no los que yo creo que realmente son mis mejores trabajos. Me he permitido la licencia de ser “irreductible” en una de las sustitutorias, donde he puesto una aportación de investigación sobre aprendizaje. Porque desde el primer sexenio me impuse el compromiso de poner siempre al menos una investigación docente en mis aportaciones:

De las 5 aportaciones principales, yo solo habría mantenido una o dos de ellas (y también habría puesto otra en lugar de una de las sustitutorias). ¿Por qué no lo he hecho? Porque me “he cagado”. Tengo la seguridad de que no lo iban a entender en la comisión y que peligraba el sexenio… que no pasa nada, ya tengo 3 sexenios, y un sexenio son solo 140 euros al mes de extra en la nómina. Es triste, pero me he vendido por 140 euros de mierda (que, además, no me hacen falta para llegar a final de mes, esa enorme suerte tengo).

¿Cuales hubiera puesto yo de no haberme “cagado”? Sin duda, habría puesto al menos dos contribuciones sobre las cosas que hicimos durante la época de COVID, en la que nos volcamos a dedicar horas y todos nuestros conocimientos para apoyar a los hospitales. A los que nos quisieron como colaboradores, y hasta que nos obligaron a dejar de colaborar con ellos desde las altas esferas (bueno, nunca les hicimos caso y seguimos desde la clandestinidad 😉 ). Gracias a ello, recibimos el premio “Luis Merelo y Más” del Colegio de Ingenieros Industriales de la Comunidad Valenciana. Muchas de las cosas que aprendimos entonces también las pudimos aplicar durante la catástrofe de la Dana del 2024. Como representativo de esta línea hubiera elegido estos dos trabajos:

Además, habría puesto mis artículos sobre guías para la difusión de la ciencia. Sinceramente creo que son de las cosas más útiles e interesantes que he hecho (aunque sea yo el único que piense eso):

También habría incluido alguna aportación representativa de mi línea de investigación en Gestión de Recursos Humanos. Mi solicitud ha quedado demasiado sesgada hacia la Dirección de Operaciones. Por ejemplo habría incluido:

Resumiendo, no me he atrevido a dejarme llevar por la interpretación que yo hago de cuál creo que es el espíritu de la norma. He preferido autocensurarme y hacer una solicitud estándar, del montón, doblegando mi espíritu crítico, mi creatividad, y mi compromiso con una pasión para encajar en el estrecho corsé de lo que creo (sin ninguna certeza) que se puntúa en mi campo científico. Esto me deja una profunda desazón y vergüenza. No ha sido una experiencia agradable el tener que pasar por esto. Y me deja preocupado. Si algo que no necesito es capaz de pervertir mi comportamiento, y hacer que me venda y me aleje de mis creencias solo por conseguir una métrica, estamos realmente “jodidos” en la academia.

Si no tuviera la seguridad de que me van a sobrar aportaciones y que, por lo tanto, puedo dedicarme a investigar lo que creo, en conciencia, que es lo que debo investigar, habría tenido una enorme presión por dejar de hacer las cosas en las que creo, para dedicar mi escaso tiempo solo a las cosas que me van a puntuar. Por suerte, yo abordo todo lo que hago como un proyecto de publicación de artículos, lo que me genera un volumen alto de opciones y permite que, cosas que sé desde el principio que jamás serán puntuables, puedan tener su oportunidad de existir y ser encontradas por potenciales lectores.

Mientras escribo esta entrada, me ha llegado al mi bandeja de entrada este anuncio de publicación de artículo:

El problema es tanto conceptual como metodológico. Por un lado, la naturaleza misma del trabajo académico en ciencias sociales genera impacto de forma indirecta y diferida: los académicos transforman la sociedad a través de sus estudiantes y del conocimiento que estos llevan al mundo profesional, un proceso cuyo valor se manifiesta a largo plazo. Por otro lado, la medición del impacto carece de criterios válidos y fiables, siendo prácticamente imposible establecer una relación causal directa entre una investigación específica y cambios sociales u organizacionales concretos.

Los autores no rechazan el valor del impacto práctico, sino su imposición como criterio central de evaluación académica. La creación de conocimiento, el rigor intelectual y la libertad académica deben constituir el “imperativo” de la universidad, mientras que la aplicación práctica inmediata puede ser un resultado deseable pero no una obligación. Invertir esta prioridad, convirtiendo el impacto como motor principal de la actividad académica, supone desviar recursos intelectuales de la generación de conocimiento original hacia la demostración de utilidad inmediata, comprometiendo así la esencia misma de la institución universitaria.

Visitas: 151

I will be presenting this research at the upcoming XVII International Workshop ACEDEDOT – OMTECH 2026, taking place in Almería, Spain, from March 12-14, 2026:

This communication presents an autoethnographic reflection. Building on four fundamental premises about the function of Spanish public universities and the established mechanisms of human learning, the author documents his personal journey from initial uncertainty to the design of a systematic work plan. The study focuses on understanding the current scientific consensus on how learning is consolidated in the brain and exploring the possibilities of generative AI to enhance this process in the university context. Drawing on the work of Héctor Ruiz Martín, a work plan is designed that combines recommendations from educational neuroscience with the Feynman method and the EPLEDRE model, including spaced reading, creation of sketchnote-type graphic schemes from memory, and public communication of the knowledge constructed. The communication shares the first graphic schemes developed and reflects on the author’s dual position as university teacher and administrator, facing both his own methodological uncertainties and institutional expectations for strategic guidance. It questions the “collective panic” surrounding the emergence of generative AI in universities and the pressure to make quick decisions without sufficient reflection. It proposes replacing reactive urgency with a deliberate process of calm, evidence-based reflection and pilot experimentation, recognizing that in contexts of accelerated change, it is preferable to miss some “trains” rather than make biased decisions under collective amygdala hijacking

Keywords: Learning; autoethnography; generative artificial intelligence; university learning; educational neuroscience; teaching transformation

Visitas: 31

Este año me toca presentar la solicitud para el sexenio de investigación. La experiencia de las tres veces anteriores fue frustrante, no por el resultado (conseguí el informe favorable directo en las tres ocasiones), sino por la sensación de pérdida de tiempo en una actividad que no añadía absolutamente nada de valor (ni a mí ni a la sociedad).

Ahora voy a intentar que sea diferente; no sé si lo conseguiré, porque los sistemas pensados para “certificar” la calidad, y no para “promover” la calidad, no ayudan demasiado y tienen una pasmosa capacidad para convertir las tareas en “No Valor Añadido, No Evitable”.

¿Qué es lo que me planteo? Aprovechar que voy a hacer una mirada retrospectiva a mis publicaciones y reflexionar sobre el impacto social, la contribución al progreso del conocimiento y el impacto científico para decidir qué cosas tengo que cambiar en el futuro.

El principal problema que anticipo es que los indicadores que tendré disponibles no me darán ninguna información relevante para tomar decisiones.

Por ejemplo, aunque se me hubiera ocurrido etiquetar con la TAG #sexeniosjamgupv2025 todas las entradas que he hecho en las diferentes redes sociales, ¿para qué me sirve ver el número de “likes” en linkedin, Facebook, X o Bluesky? ¿Realmente me dice algo sobre cómo mejorar el tipo de investigación que hago?

Supongo que podría decir algo parecido de las citas, ¿que no me citen (o que me citen) significa que realmente no (si) se han leído mi trabajo?

Y si no me sirven los indicadores disponibles, ¿cómo puedo tomar decisiones basadas en evidencia y no usar autoengaños para justificarme ante mí mismo?

Pues este tipo de cosas son las que quiero darles algunas vueltas las próximas semanas. Si no aclaro nada, esta edición de la solicitud de sexenios habrá sido, una vez más, una pérdida de tiempo. Si saco alguna conclusión, tendré que agradecer a ANECA por obligarme a invertir mi tiempo en preparar una solicitud que ha desencadenado un proceso beneficioso.

Visitas: 88

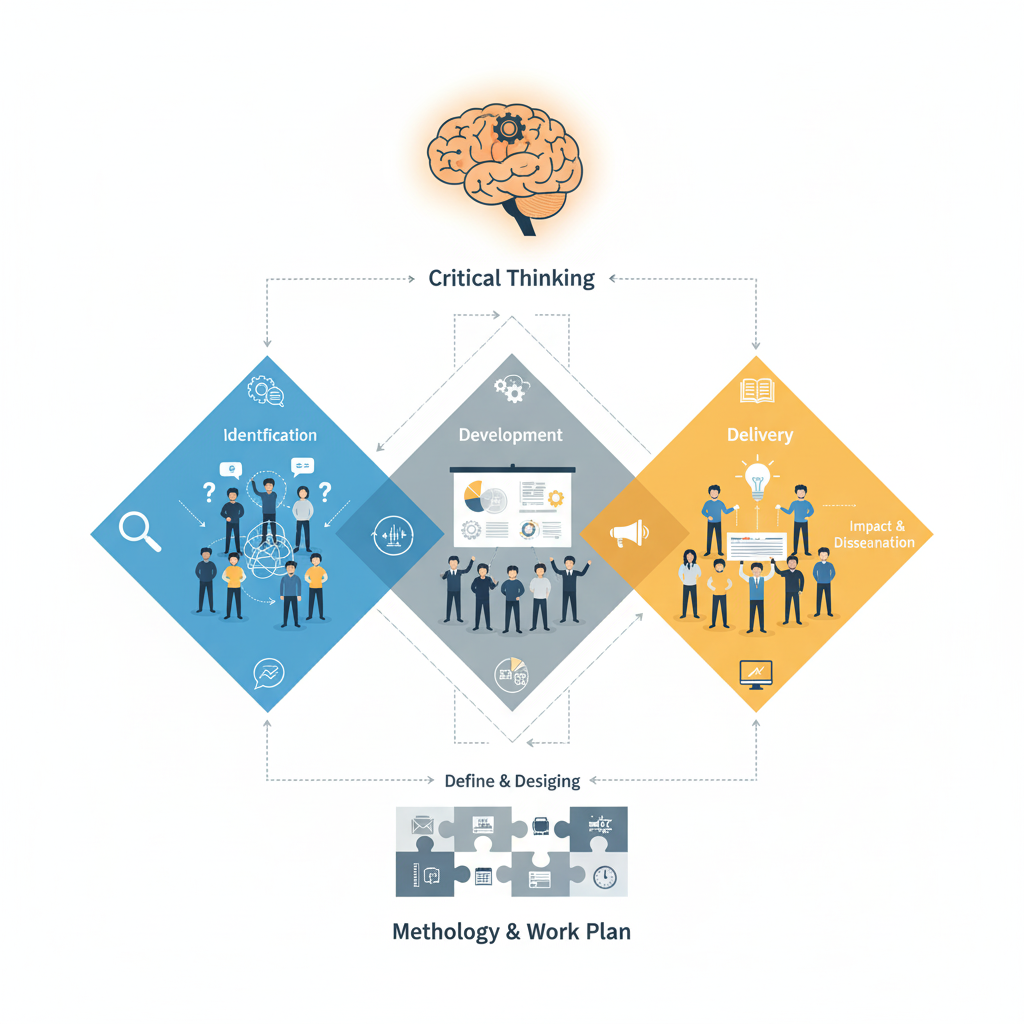

Extended Title: Action research on designing materials, protocol, and feasibility of a complex intervention to foster critical thinking and apply the triple diamond framework in group decision-making.

This project aims to enhance students’ critical thinking and decision-making skills by developing, testing, and refining a structured group decision-making framework called the triple diamond. It focuses on identifying misconceptions that hinder students’ use of this framework and improving pedagogical interventions through active, collaborative learning and evidence-based methodologies.

#PI-DECIDE

Visitas: 27

El 14 de marzo 2025, presentaremos nuestro trabajo Optimizing the screening of scientific literature: Artificial or Human Intelligence? en el XVI Workshop in Operations Management and Technology en Melilla.

This paper analyses the use of artificial intelligence (AI) in scientific literature screening, comparing its performance with the consensus of human researchers. The objective is to evaluate three methods: 1) generative AI using chatbots such as ChatGPT and Claude; 2) supervised learning with the Rayaan algorithm; and 3) similarity ranking based on sentence Transformers embeddings, proposed by Marin-Garcia et al. (2024). The study aims to determine whether any of these methods reduce manual effort and improve efficiency metrics such as accuracy, repeatability and time spent. It will also investigate the generalisability of these models to different scientific areas and whether the integration of multiple models improves the consistency of results in complex texts.

Alfalla- Luque, R., Luján García, D. E., & Marin- Garcia, J. A. (2023). Supply chain agility and performance: evidence from a meta- analysis. International Journal of Operations & Production Management, 43(10), 1587-1633. https://doi.org/10.1108/ijopm- 05- 2022- 0316

Marin- Garcia, J. A., Martinez- Tomas, J., Juarez- Tarraga, A., & Santandreu-Mascarell, C. (2024). Protocol paper: From Chaos to Order. Augmenting Manual Article Screening with Sentence Transformers in Management Systematic Reviews. WPOM- Working Papers on Operations Management, 15, 172-208. https://doi.org/10.4995/wpom.22282

Rafaela Alfalla-Luque Alina Díaz Curbelo Juan A. Marin-Garcia Juan Martínez cartoonabstract

Visitas: 46

Marin-Garcia, J. A., Martinez-Tomas, J., Juarez-Tarraga, A., & Santandreu-Mascarell, C. (2024). Protocol paper: From Chaos to Order. Augmenting Manual Article Screening with Sentence Transformers in Management Systematic Reviews. WPOM-Working Papers on Operations Management, 15, 172–208. https://doi.org/10.4995/wpom.22282

This protocol paper describes a new method to help researchers screen and classify scientific articles more efficiently during systematic literature reviews. The authors propose using AI language models called “sentence transformers” to automatically analyze article titles and abstracts, comparing them to the review’s topic of interest. This helps researchers prioritize which articles to review first, rather than working through them randomly. The method was tested with 14 different AI models on a small set of articles about workplace management practices.

As scientific publications grow exponentially, researchers struggle to efficiently review all relevant literature. This method could: * Save significant time in the screening process * Reduce researcher fatigue and potential bias * Make systematic reviews more accessible to researchers with limited resources * Help democratize access to advanced AI tools for academic research * Support evidence-based management practices by making literature reviews more feasible The approach is particularly valuable because it’s designed to complement rather than replace human judgment, and can be implemented using free, accessible tools.

This protocol represents an innovative bridge between cutting-edge AI technology and traditional academic research methods. The authors’ commitment to making the tool freely available and easy to use for researchers worldwide, regardless of technical expertise or resources, is particularly noteworthy. The pilot results suggest promising potential, though more testing is needed to validate the approach at larger scales.

This page is a summary of: Protocol paper: From Chaos to Order. Augmenting Manual Article Screening with Sentence Transformers in Management Systematic Reviews, WPOM – Working Papers on Operations Management, December 2024, Universitat Politecnica de Valencia,

DOI: 10.4995/wpom.22282.

Visitas: 9

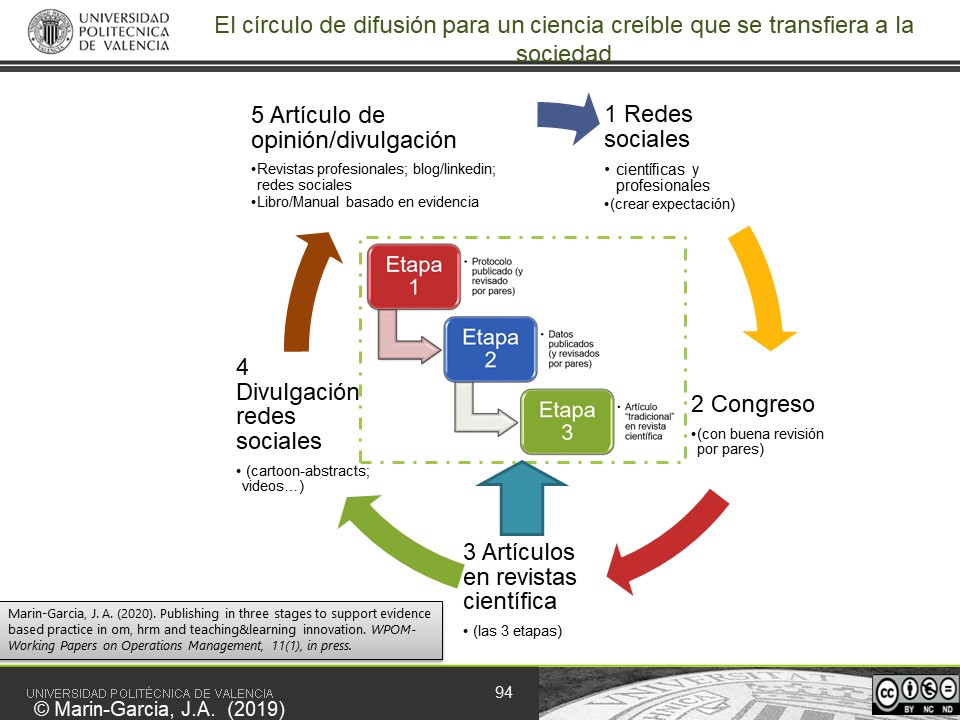

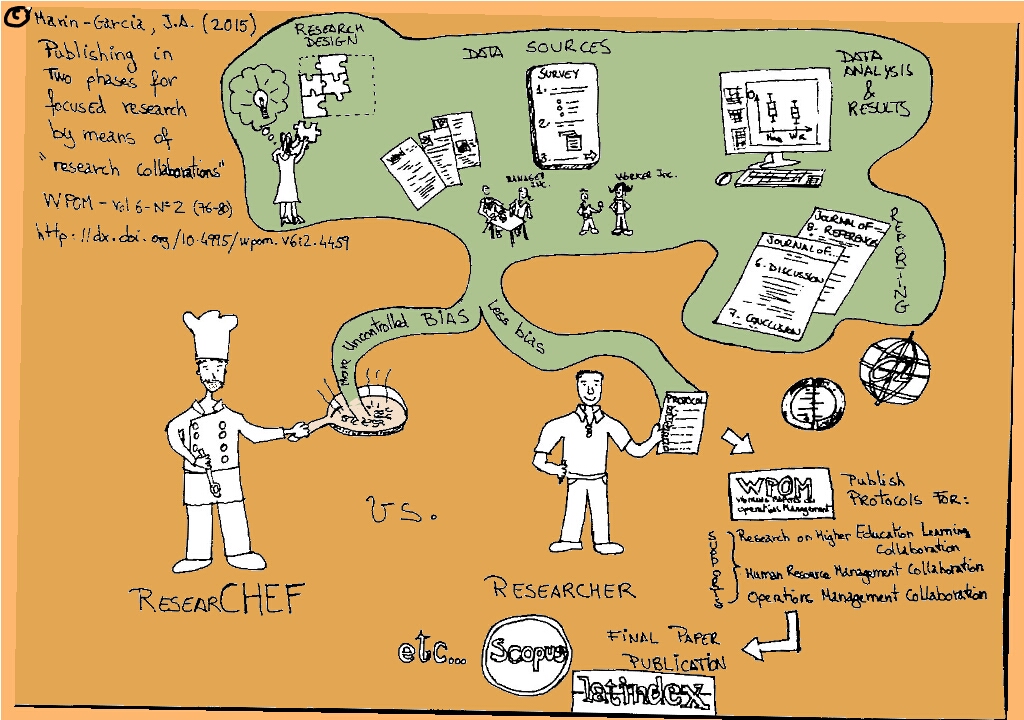

Marin-Garcia, J. A. (2021). Three-stage publishing to support evidence-based management practice. WPOM-Working Papers on Operations Management, 12(2), 56–95. https://doi.org/10.4995/wpom.11755

This paper proposes a new model for publishing scientific research in business and management that aims to make studies more transparent and useful for practitioners. The model includes three key stages: 1) Publishing the research protocol/plan before starting, 2) Publishing the collected data, and 3) Publishing the final results and conclusions. This approach helps ensure research is well-planned, data is accessible for verification, and findings can be confidently applied in real-world management practice.

Currently, there’s a big gap between management research and practice – many research findings never get implemented by actual managers. This model helps bridge that gap by: * Making the research process more transparent and trustworthy * Ensuring data quality through peer review at each stage * Making it easier for practitioners to access and understand findings * Encouraging more systematic, well-planned studies * Supporting evidence-based management decisions The model could significantly improve how management research is conducted and shared, ultimately making it more valuable for both academics and practitioners.

This innovative proposal challenges traditional publishing approaches in management research. While similar models exist in medicine and other fields, this is one of the first attempts to systematically apply such rigorous standards to business research. This offers a practical solution to improve research quality and impact. The detailed guidelines and examples make this a valuable roadmap for researchers wanting to conduct more transparent, reproducible studies.

Visitas: 15

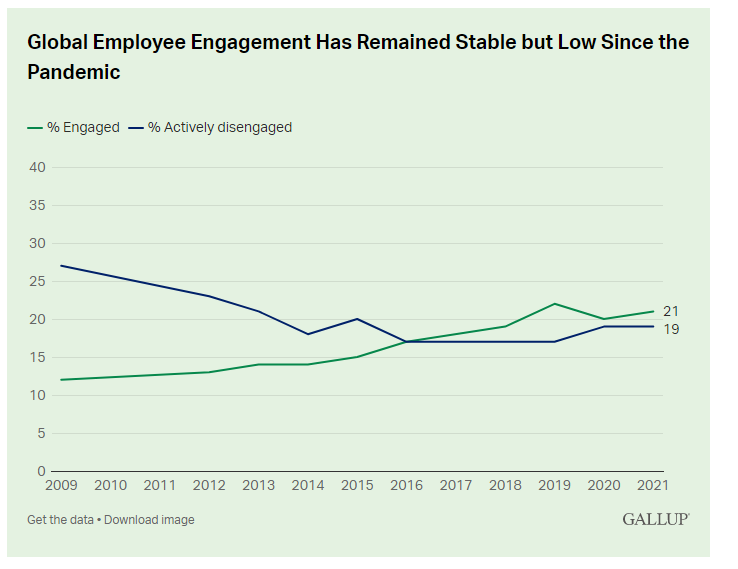

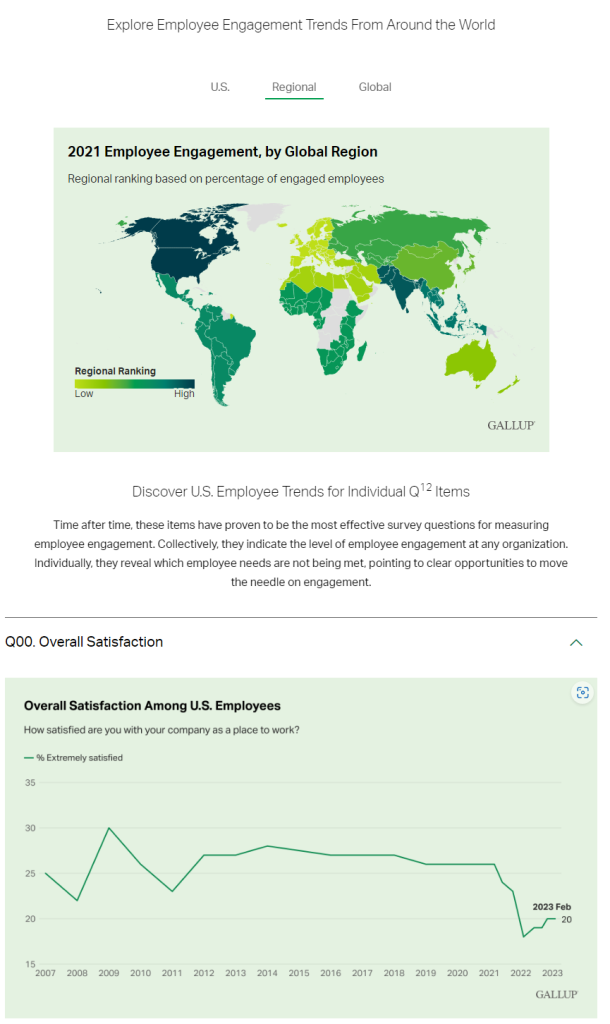

Source: Global Indicator: Employee Engagement – Gallup

Los datos provienen de la engagement survey. La encuesta se pasa periódicamente y según la página web de Gallup, han recogido más de 2.7 millones de respuestas de personas que trabajan en más de 100.000 equipo en organizaciones más de 50 actividades económicas a lo largo de todo el mundo. La información que he encontrado sobre la “Gallup World Poll” (https://www.gallup.com/178667/gallup-world-poll-work.aspx) indica que el muestreo es aleatorio (por rutas estratificadas) entre personas mayores de 15 años que trabajan al menos ciertas horas para un empleador. Se realiza la entrevista de forma telefónica o cuestionario web autoadministrado en los países desarrollados y de manera presencial en los países emergentes. A entrevista dura unos 30 minutos y les preguntan muchas cosas además del Q12. Encada país se recogen entre 500 y 1000 respuestas (menos en Rusia y China que se recogen 2000). En esta ruta puedes encontrar detalles sobre la administración en cada país (https://www.gallup.com/services/177797/country-data-set-details.aspx)

Su instrumento de medida es el Q12. Que mide la percepción de empleados/as respecto a 12 ítems (yo prefiero medir el engagement con otra herramienta, y creo que esta mide un mezcladillo de cosas, no solo engagement. Pero no me voy a poner quisquilloso con esto). El engagement podríamos definirlo de forma rápida como la implicación y el entusiasmo de una persona empleada acerca de su trabajo y de la organización para la que trabaja.

Gallup clasifica a las personas empleadas en tres categorías usando una formula propia (y no compartida) que pondera los diferentes elementos y la adapta a diferentes circunstancias (de modo que no se puede reproducir sumando las personas que responden “totalmente de acuerdo” y “de acuerdo” a cada ítem). Estas tres categorías son:

La evolución global del indicador de engagement muestra que en los años recientes se ha estancado (o reducido el número de personas implicadas, y, al mismo tiempo ha crecido el de activamente desconectadas).

Mi reflexión. Si llegamos a un punto de equilibrio donde hay la misma cantidad de personas desconectado como implicadas, la resultante es cero… unas destrozan y anulan el esfuerzo de las otras. De modo que, poco a poco, las implicadas dejarán de estarlo porque verán que su esfuerzo no vale para nada… Quizás la única solución es mimar todo lo que puedas a las personas implicadas que tengas y ver si hay algo que puedes hacer con las desconectadas, o para evitar que las no implicadas se vayan al lado oscuro en masa.

Insisto en que no estoy seguro de que el Q12 mida exactamente engagement, o que solo engagment. Pero mida lo que mida, Europa es el lugar de mundo con menos de eso en 2021 (según los datos de Gallup).

Y si nos fijamos en los datos de satisfacción (solo he encontrado los datos de USA), se aprecia una gran bajada en las personas “extremadamente satisfechas con la organización para la que trabajan” en los últimos años. No obstante, hay que tener en cuenta que la gráfica está truncada y el “salto” da la impresión de ser más grande de lo que sería en realidad si el eje de ordenadas empezara en cero.

¿Estará pasando algo parecido en Europa? ¿Y en España?

¿Crees que sería interesante que analizáramos estos datos de Europa y desglosado por actividad económica, tipo de ocupación y sector público vs privado?

Visitas: 51