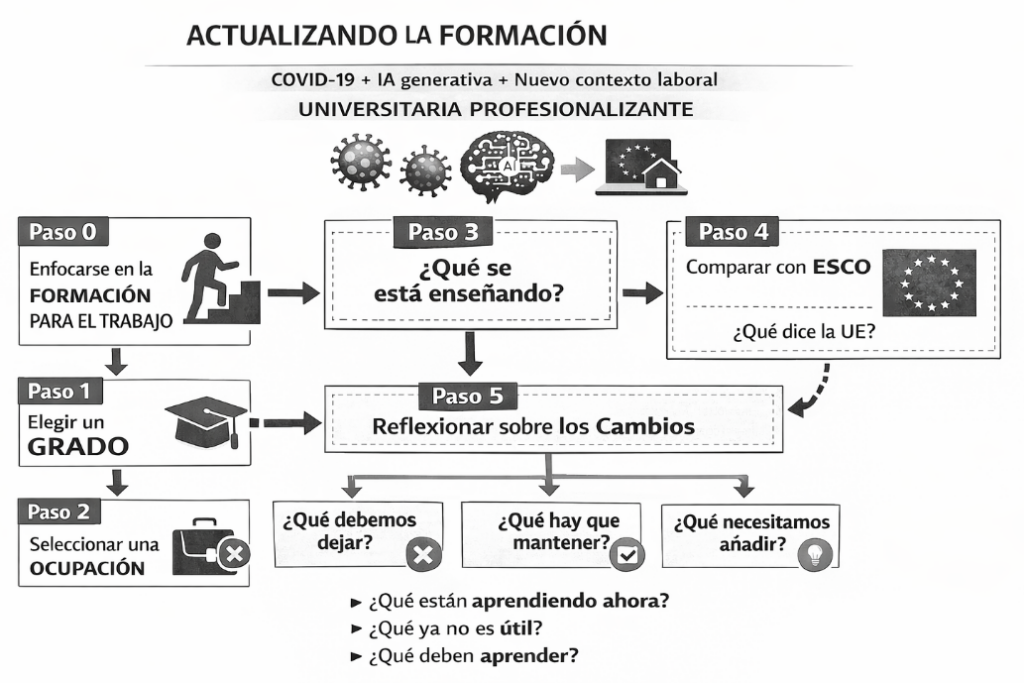

- ¿Qué están aprendiendo ahora?

- ¿Qué deberían dejar de aprender porque no es útil?

- ¿Qué cosas nuevas deberían empezar a aprender porque las necesitarán para ser buenas profesionales?

Caso de uso:

(en construcción)

Visitas: 7

(en construcción)

Visitas: 7

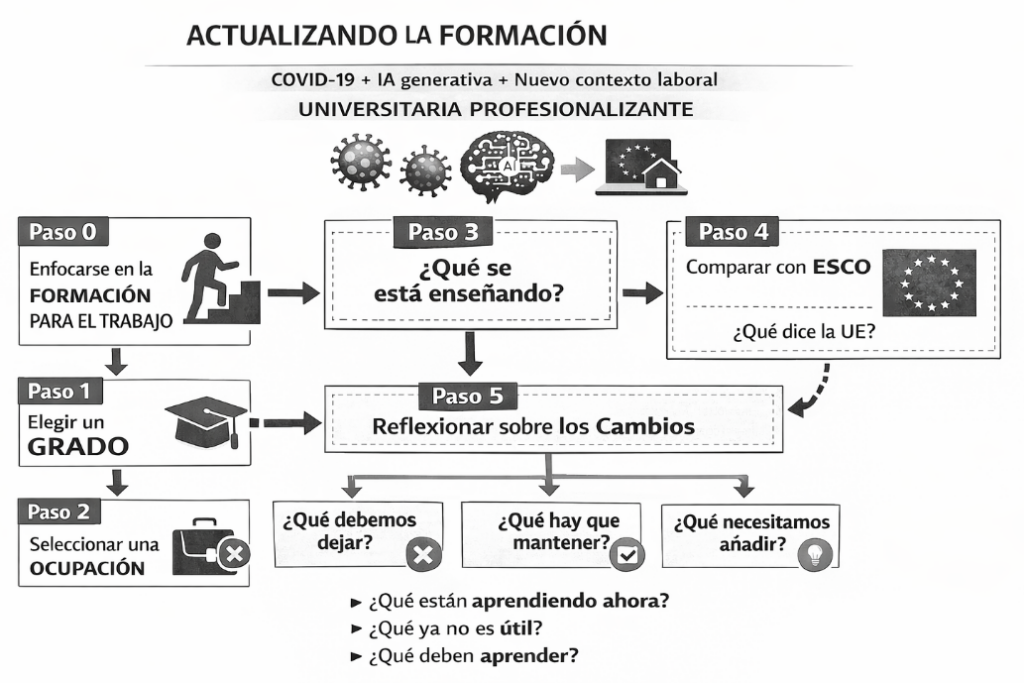

Marco AIR para uso responsable de IA: útil pero revelador de nuestras inconsistencias

Young, J. (2026). AIR: AI in Research – A framework for transparent and responsible AI use mapped to the research process (Version 1). figshare. https://doi.org/10.6084/m9.figshare.31268020.v1

Creo que es muy útil para resolver algunas de las dudas que surgen en mis charlas sobre IA generativa en Research.

Con esta tabla, en menos de 5 minutos, puedes informar con transparencia sobre el uso que has hecho de la IA y las verificaciones que has realizado (la última columna) para estar seguro de que lo etiquetado como riesgo moderado no representa ningún “concern” para la validez de tu trabajo.

Intentar justificar que lo etiquetado como riesgo elevado no te afecta podría dar lugar a un artículo por cada una de las casillas de la columna A4.

Y este es el talón de Aquiles de todo esto… si alguien te obliga a demostrar punto por punto que estás exento de riesgos y sesgos, igual necesitas uno o dos años de trabajo para justificar adecuadamente cualquier artículo… incluso los que has escrito completamente “a mano” sin ayuda de ninguna IA generativa.

Es un poco sorprendente el doble rasero que se aplica, no pidiendo ninguna justificación si lo haces tú solito (proyectando todas tus torpezas y sesgos implícitos), y abrumándote con justificaciones si te apoyas en IA generativa. No, si no está prohibido que la uses, pero si dices que la usas, debes invertir una burrada de horas de trabajo para justificar “adecuadamente” que el uso ha sido correcto.

¿Alguien me ha preguntado alguna vez si he usado correctamente SPSS en los artículos que he escrito en los últimos 30 años? ¡Pero si, las veces que intento adjuntar la sintaxis, los revisores me dicen que quite esa información porque les “despista” y hace innecesariamente largo el artículo!

Visitas: 80

I will be presenting this research at the upcoming XVII International Workshop ACEDEDOT – OMTECH 2026, taking place in Almería, Spain, from March 12-14, 2026:

This communication presents an autoethnographic reflection. Building on four fundamental premises about the function of Spanish public universities and the established mechanisms of human learning, the author documents his personal journey from initial uncertainty to the design of a systematic work plan. The study focuses on understanding the current scientific consensus on how learning is consolidated in the brain and exploring the possibilities of generative AI to enhance this process in the university context. Drawing on the work of Héctor Ruiz Martín, a work plan is designed that combines recommendations from educational neuroscience with the Feynman method and the EPLEDRE model, including spaced reading, creation of sketchnote-type graphic schemes from memory, and public communication of the knowledge constructed. The communication shares the first graphic schemes developed and reflects on the author’s dual position as university teacher and administrator, facing both his own methodological uncertainties and institutional expectations for strategic guidance. It questions the “collective panic” surrounding the emergence of generative AI in universities and the pressure to make quick decisions without sufficient reflection. It proposes replacing reactive urgency with a deliberate process of calm, evidence-based reflection and pilot experimentation, recognizing that in contexts of accelerated change, it is preferable to miss some “trains” rather than make biased decisions under collective amygdala hijacking

Keywords: Learning; autoethnography; generative artificial intelligence; university learning; educational neuroscience; teaching transformation

Visitas: 31

Mis “take away” de la lectura de esta entrada de blog de Ethan Mollick:

He tenido que rebuscar un poco para clarificar los conceptos de skill y agent, este es mi resumen:

Visitas: 14

He leído varios blogs estos días donde me ha parecido que sus autoras-es se quejaban de que los “copilotos IA” están mal diseñados y que son los culpables de todos los malos usos que se les están dando. Igual no es lo que querían decir, pero es el mensaje que me ha calado.

Esto me ha llevado a dos reflexiones:

Visitas: 4

En unas jornadas en noviembre 2025 se me ocurrió preguntar si conocían el significado de algunos términos que, para mí, son básicos sobre IA generativa (si no sabes lo que significan dudo mucho que puedas entender cómo funciona y mucho menos pilotarla adecuadamente)

Asistieron unas 50 personas, todas ellas profesoras de universidad, en diferentes titulaciones y departamentos y con diferente trayectoria académica – desde jóvenes recién entradas a catedráticas -, y con cierta sensibilización y práctica como usuarias de Inteligencia Artificial Generativa (no creo que se pudieran considerar “novatas” o que acabaran de descubrir qué es esto de la IAgen).

Y estos son los resultados:

Visitas: 58

(contenido creado a finales de 2025, no sé lo bien o mal que envejecerá este post)

Con frecuencia, mis colegas investigadores me preguntan sobre qué plataforma de IA les recomiendo que pueda dar buenas respuestas a preguntas científicas/profesionales. Me ponen por ejemplo que los profesionales de medicina usan cosas como OpenEvidence ; Search – Consensus: AI Search Engine for Research ; Elicit: AI for scientific research …

Mi opinión en estos momentos, basada en los experimentos que llevo haciendo desde hace un par de años (experimentos informales, no del todo sistemáticos, y sobre todo centrados en los temas o asuntos que me interesan a mí en mi día a día como investigador, docente y consultor), es que no hay nada en nuestro campo que aporte resultados “decentes” (que sean útiles, ciertos o que no tengan un sesgo tremendo en la respuesta).

Tanto OpenEvidence como Consensus, Elicit y similares solo aciertan (cuando aciertan) con literatura de ciencias de la salud.

Los motivos son claros para mí. Primero el modo que esas comunidades difunden su ciencia:

Eso les permite que la IA pueda sacar resultados interesantes.

Además, aunque ya más tangencialmente, el conjunto de documentos con el que se ha entrenado el modelo (que claramente está sesgado a esas ciencias, porque entiendo que es donde más negocio pueden hacer los que venden esas plataformas).

Sin embargo, en el caótico mundo de la investigación en Management, donde cada uno pone el nombre que le da la gana a las “cosas” y midiéndolo cada vez de una forma distinta, el resultado es que una misma palabra significa cosas distintas en distintos artículos (homonimia) y, al mismo tiempo, las mismas cosas se nombran con palabras completamente diferentes (sinonimia).

No sé si resolviendo esto resolveríamos completamente el problema, pero habríamos dado un paso de gigantes para poder hacer una extracción sistemática a gran escala del enorme conocimiento que se ha ido generando en el área y que, de momento, está enmarañado.

Visitas: 68

El otro día me enteré de que hay empresas que subcontratan por completo sus memorias de sostenibilidad a consultoras externas. Y no me refiero a buscar apoyo técnico o asesoramiento, sino a delegar absolutamente todo el proceso. Esto me hizo reflexionar sobre un patrón que ya he visto repetirse con mucha frecuencia.

La lógica inicial es aparentemente sólida: cuando surge una nueva normativa que obliga a elaborar memorias sobre cualquier tema relevante (sostenibilidad, igualdad, transparencia, gestión de títulaciones, etc.), la idea detrás de la normativa es estimular la reflexión. El ejercicio de analizar qué hacemos, por qué lo hacemos y cómo podríamos hacerlo mejor debería ser una oportunidad de crecimiento y mejora continua. Sin embargo, cuando estas normativas llegan impuestas desde arriba, muchas organizaciones no las perciben como una oportunidad, sino como una carga burocrática, algo que etiquetan como No-Valor-Añadido-No-Evitable.

¿Cómo funciona la cadena de la externalización? Pues la verdad es que con un proceso bastante absurdo: la empresa contrata a una consultora (o un becario-a) para que busque los datos (o los invente, da igual), elabore un análisis con esos datos y redacte una memoria que cumpla con todos los requisitos legales. El objetivo no es aprender ni mejorar, sino simplemente evitar problemas regulatorios. La empresa que contrata ni siquiera lee el documento final.

Ahora estas consultoras (o estos becarios) están delegando todo el proceso (o toda la parte que pueden) a herramientas de inteligencia artificial generativa. El resultado es una farsa perfectamente orquestada: la empresa presenta memorias impecables, con una calidad de redacción como jamás había conseguido y un número impresionante de páginas. Los organismos auditores están satisfechos porque reciben más memorias que nunca, creyendo que están cumpliendo su misión de velar por la mejora en su área de responsabilidad.

Sin embargo, en todo este proceso no hay ni una sola neurona dedicada a pensar realmente en cómo mejorar o dónde pueden estar los problemas. La rueda sigue girando, pero ahora con muchas más personas implicadas, más gasto de energía y más dinero invertido en una actividad que ha perdido completamente su propósito original.

Mi Estrategia Personal

Frente a este panorama, he decidido adoptar una estrategia diferente. Voy a centrarme en encontrar usos para la IA generativa que me ayuden a aprender, a crecer intelectualmente y a explorar territorios que antes estaban fuera de mi alcance. Aprovecharé que la IA aún es relativamente barata porque las empresas necesitan nuestros datos para seguir entrenando sus modelos. Cuando se me acabe este chollo tecnológico, volveré tranquilamente a leer libros (o, dependiendo de la edad a la que me pille, a jugar a la petanca).

Si, además, consigo contagiar a alguien más para que use estas herramientas de manera inteligente, genial. Si no lo logro, tampoco me agobia. Lo importante es que yo voy a aprovechar esta oportunidad mientras dure.

Todo esto me recuerda a las clases de educación física en el colegio. A mí me encantaba dar vueltas al campo porque disfrutaba haciendo ejercicio. Algunos compañeros se escondían detrás de un árbol y aparecían solo en la última vuelta para que el profesor los viera llegar. Yo me lo pasaba muy bien corriendo, ellos se lo pasaban muy bien escondiéndose. Cada uno disfrutaba de la opción que había elegido. Nunca me importó que otros se escondieran (es más, me dejaban la pista más libre para correr a mi ritmo). Me habría fastidiado tener que esconderme y perder el tiempo en lugar de dar tres vueltas más al campo, pero nadie me impidió correr. Ahora creo que la situación es similar: puedo elegir cómo relacionarme con estas nuevas herramientas, independientemente de lo que hagan los demás.

Vivimos en una época en la que es fácil dejarse arrastrar por la corriente del mínimo esfuerzo y la externalización de todo lo que requiere pensamiento crítico. Pero también tenemos la oportunidad de usar estas mismas herramientas que otros emplean para evitar pensar, precisamente para pensar mejor y llegar más lejos. La elección, al final, es nuestra.

El problema no está en la tecnología en sí, sino en cómo decidimos relacionarnos con ella. Podemos usarla como una muleta para evitar el esfuerzo intelectual o como una palanca para amplificar nuestras capacidades de reflexión y aprendizaje. Yo tengo claro qué opción elijo.

Visitas: 39

He comparado la respuesta de Claude-sonnet-4 y las de 4 grupos de estudiantes de máster (5 personas en cada grupo) con un caso que he preparado como diagnóstico inicial para comprobar las competencias de mis estudiantes el primer día de clase.

Mis estudiantes han estado trabajando 2 horas sobre un caso de 5 páginas donde su tarea estaba descrita en un párrafo y el resto era información de contextualización.

El Prompt usado con Claude-sonnet-4 en poe.com era simplemente el párrafo de descripción de la tarea a realizar sin ningún contexto adicional (ni de nivel de estudios, ni de contexto… nada).

“resuelve este caso “”Formas parte de un proyecto que pretende alinear el uso de Inteligencia Artificial (IA) con los valores y objetivos estratégicos de la UPV, de modo que la IA ayude a construir

en lugar de minar el futuro que queremos ser.

Como grupo, debéis manifestar vuestro punto de vista, como estudiantes universitarios,

sobre cómo percibís la IAgen, explorar los problemas o inquietudes que os genera en los

diferentes usos o funciones en las que os afecta como estudiantes en la universidad y

clasificarlos/filtrarlos. Para acabar proponiendo un listado de recomendaciones (o guías)

de uso que sugerís para resolver las causas que originan los problemas que consideráis

como principales y un plan para la implementación de esas recomendaciones.”””

Todos los grupos de estudiantes, en lugar de hacer unas guías para estudiantes, han hecho recomendaciones para la universidad o sus equipos directivos. Claude-sonnet-4 ha cometido exactamente el mismo error en la primera iteración. No obstante, su informe ha sido mucho mejor que el de cualquiera de los grupos.

Le he pedido a la IA una segunda iteración: “las recomendaciones que has dado son para la institución, no has respetado la tarea que era crear recomendaciones para los estudiantes. Por otra parte, ajusta el reporte al modelo triple diamante”. En este caso ha clavado las recomendaciones, aunque su interpretación de lo que era el “framework” de triple diamante dejaba mucho que desear, pero le hubiera puesto un 5 o un 6 de nota a ese ejercicio (los ejercicios de mis estudiantes no creo que pasen de un 2 o un 3, pero a ellos no les he dado la oportunidad de repetirlo).

Cuando les pido a mis estudiantes, a PRINCIPIO de curso que resuelvan un caso y les valoro en base a los resultados de aprendizaje que esperaría que tuvieran a FINAL de curso, la IA generativa les da “mil vueltas” (o por lo menos una decena).

Lo interesante aquí es qué pasará al final del curso cuando mis estudiantes hayan superado los resultados de aprendizaje esperados. La IA generativa no mejorará su nota de 5-6 (salvo que estemos ante un nuevo modelo), entonces creo que serán mis estudiantes los que le darán mil vueltas a la IA generativa.

Visitas: 31

En una de mis charlas sobre uso de IA generativa para personal investigador salió el tema de cuanta Agua/energía consume el uso de IA generativa. Se comentó que alguien había leído que eran como varios litros de agua por cada imagen generada. A mí eso me pareció desorbitado, pero no tenía ninguna cifra o información que aportar. Se me ocurrían varias formas de estimarlo, aunque fuese de manera muy aproximada. Algunas de ellas eran por el método de “reducción al absurdo”, en otras llegué a barajar la posibilidad de montarme un modelo en local y medir el consumo…

Pero gracias a este post de Ethan Mollick (Mass Intelligence – by Ethan Mollick – One Useful Thing) tengo unas estimaciones que me parecen más razonables y contrastadas.

The marginal energy used by a standard prompt from a modern LLM in 2025 is relatively established at this point, from both independent tests and official announcements. It is roughly 0.0003 kWh, the same energy use as 8-10 seconds of streaming Netflix or the equivalent of a Google search in 2008 (interestingly, image creation seems to use a similar amount of energy as a text prompt)1. How much water these models use per prompt is less clear but ranges from a few drops to a fifth of a shot glass (.25mL to 5mL+), depending on the definitions of water use (here is the low water argument and the high water argument).

[…]

It does not take into account the energy needed to train AI models, which is a one-time process that is very energy intensive. We do not know how much energy is used to create a modern model, but it was estimated that training GPT-4 took a little above 500,000 kWh, about 18 hours of a Boeing 737 in flight.

Mass Intelligence – by Ethan Mollick – One Useful Thing

An example of what I consider a misleading article about AI and the environment

Cloud Carbon Footprint – An open source tool to measure and analyze cloud carbon emissions

Visitas: 27